随着 Agent 的时代的到来和 AI Coding 工具的兴起,被 AI 冲击的最狠的软件工程领域也迎来一轮一轮变化;我也在这个过程中一轮轮迭代,使用不同的 Agent 的工具,来帮助我自己提升自己的工作效率。而随着我的 Coding Agent 的使用越来越多,我的问题不再是「有没有 Agent」、「有没有用好 Agent」,而是 —— 「在保证工程质量的基础上,如何把多个 Agent 同时安排出去,把结果收回来」。

现在的问题是 「如何 Scale UP 你的 Agent 」

虽然目前 AI Coding 的覆盖率依然有待提升,但是,对于不少逛少数派的工程师来说,大家大多已经会用 Claude Code、Codex、OpenCode 一类工具。大家所面临的问题不再是将 AI 引入自己的工作流,而是

- 你已经在使用 AI 了,但你手头有 100 个任务都需要推进,每个都是 P0 任务。

- 你其实也知道每个任务怎么做,但终究只有一个你;

- 你的精力足以支撑你一个个盯这些任务,你可能会考虑多屏幕开始干活,但终究还是只能同时看 3-4 个,就很难再更大规模的扩容。

真正卡住你的不是代码能力,而是并发调度能力

为什么 Codex / Claude 的 Terminal UI 不够?

Terminal UI 从体验上来看,还是一个 Chat Bot ,你给他安排工作,让他把事情做完,这个还是单个线程的工作流;如果你有多个任务、多条分支、多种不同风格的 Agent,不可避免的要用上 Terminal 自带的多 Tab、多窗口,抑或是使用 tmux 来帮助你复用窗口,开发者本人会成为任务调度的瓶颈。

而在这个过程中, Terminal UI 的限制也有贡献,让我们集中在小范围的核心信息中把工作完成。

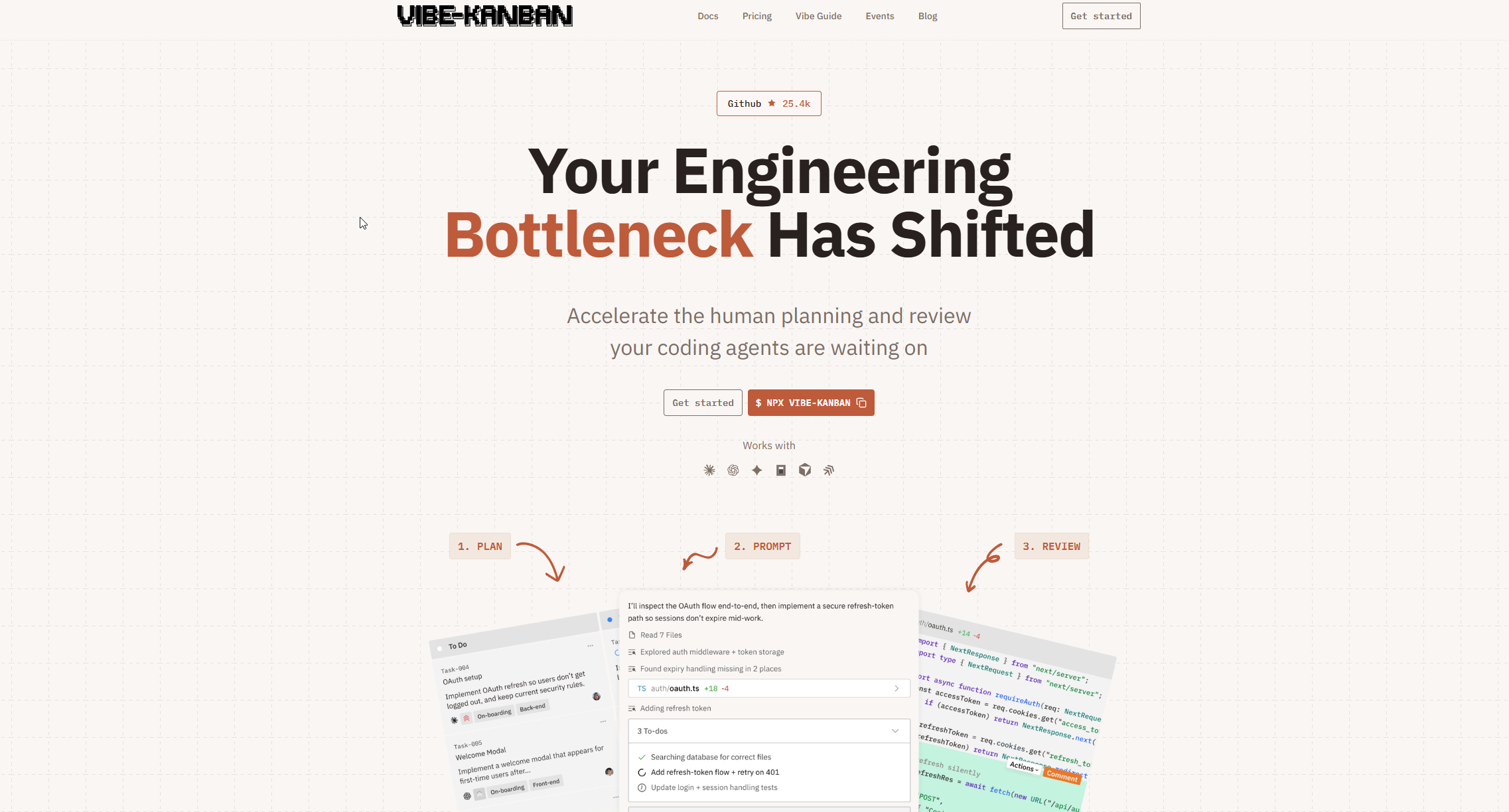

而这个过程中,我认为最接近当下我眼中最优解的便是 —— Vibe Kanban。

Vibe Kanban 在解决什么问题

如果你认真用过一段时间 coding agent,就会发现单 agent chat 界面有几个很明显的问题。

- 它天然更适合顺序执行。你可以让它完成一个明确任务,但一旦任务开始变多,吞吐量很快就会被人类自己卡住。

- 上下文很容易混。你本来只是想修一个 bug,结果顺手又让它改了另一个功能,再过一会儿,你已经忘了这段对话到底是为了解决哪个问题。

- 计划和执行是黏在一起的。很多时候不是 agent 不会写,而是你还没把任务定义清楚,它就已经开始跑了。

- review 成本越来越高。你开了更多 agent,并不自动等于你获得了更高的工程效率,很多时候只是获得了更多需要你亲自收拾的 diff。

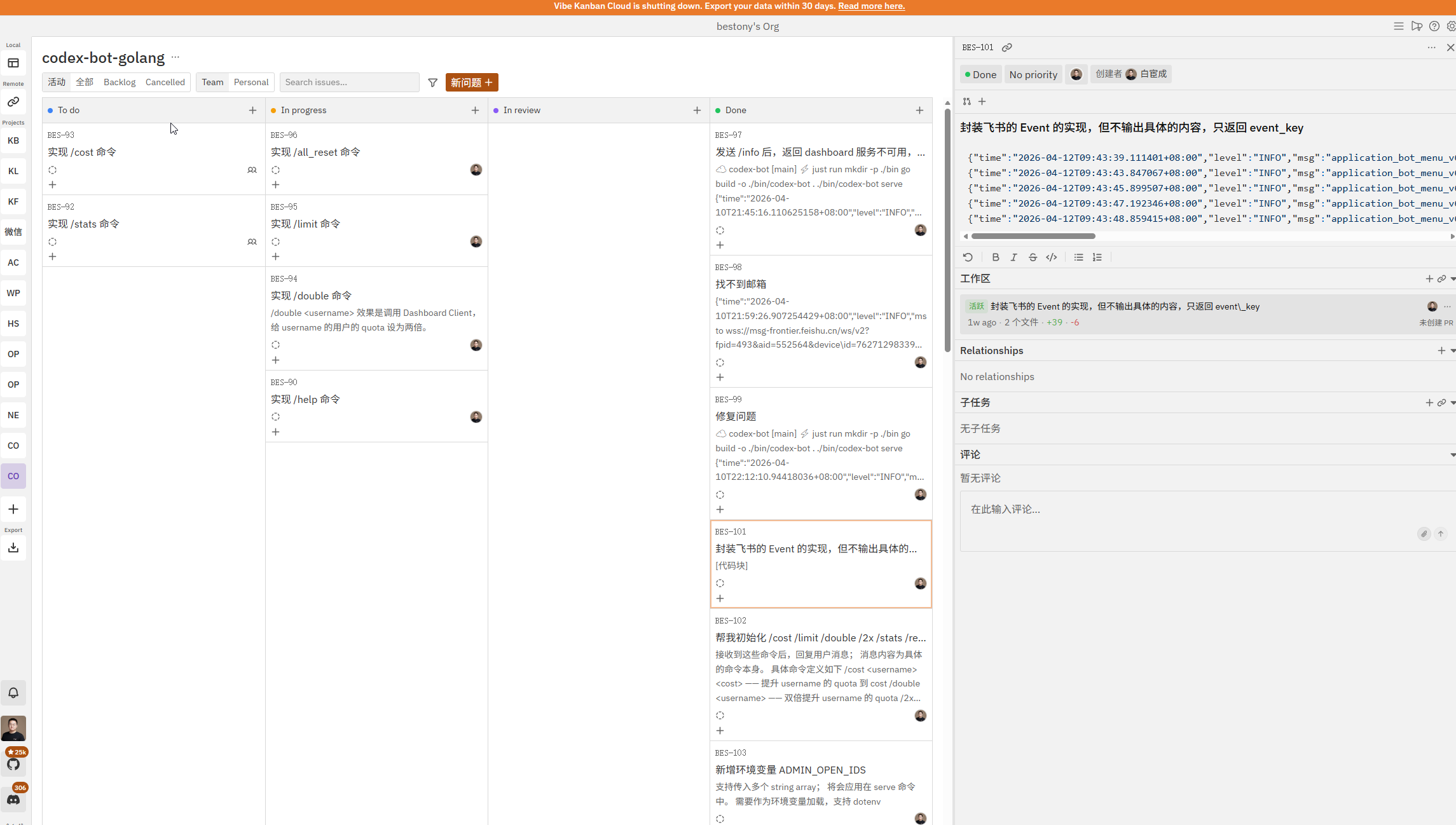

围绕着上面的这些问题,Vibe Kanban 做了一些优化,它不是新的 coding agent,而是一个把 planning、workspace、review、preview、PR 流程连起来的管理层。

这让软件工程任务从 Agent Chat 窗口中的单线程流转变成了我们更熟悉的 Kanban 机制,有了状态、有了任务,每个任务还有单独的 workspace ,我们可以使用我们熟悉的工作流,来优化完整的 Agent 落地行为。

- 先拆 issue

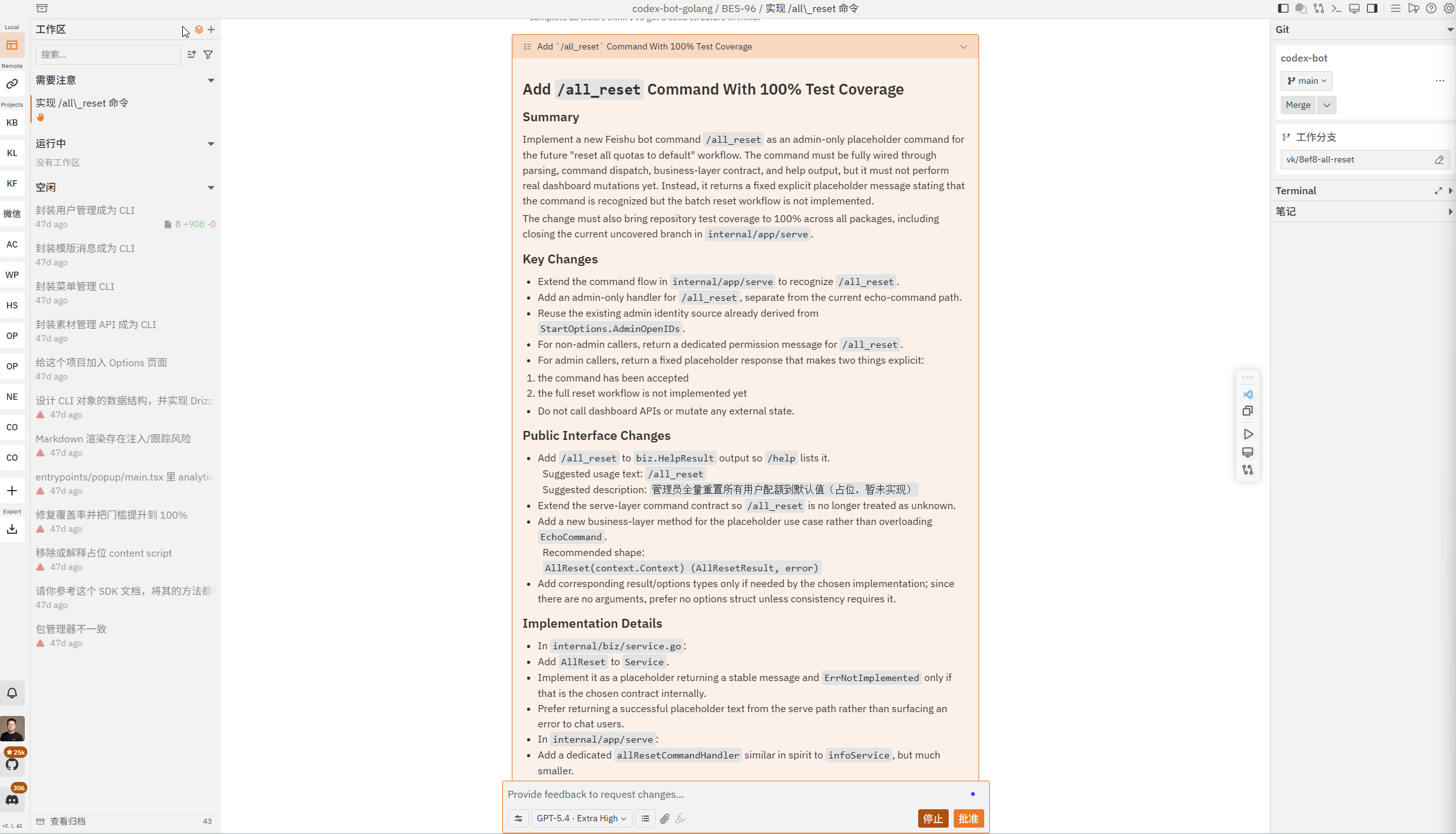

- 再明确计划

- 再开 workspace

- 再让不同 agent 去执行

- 再 review diff

- 再决定是否收敛、合并

我自己的 Vibe Kanban 的工作流

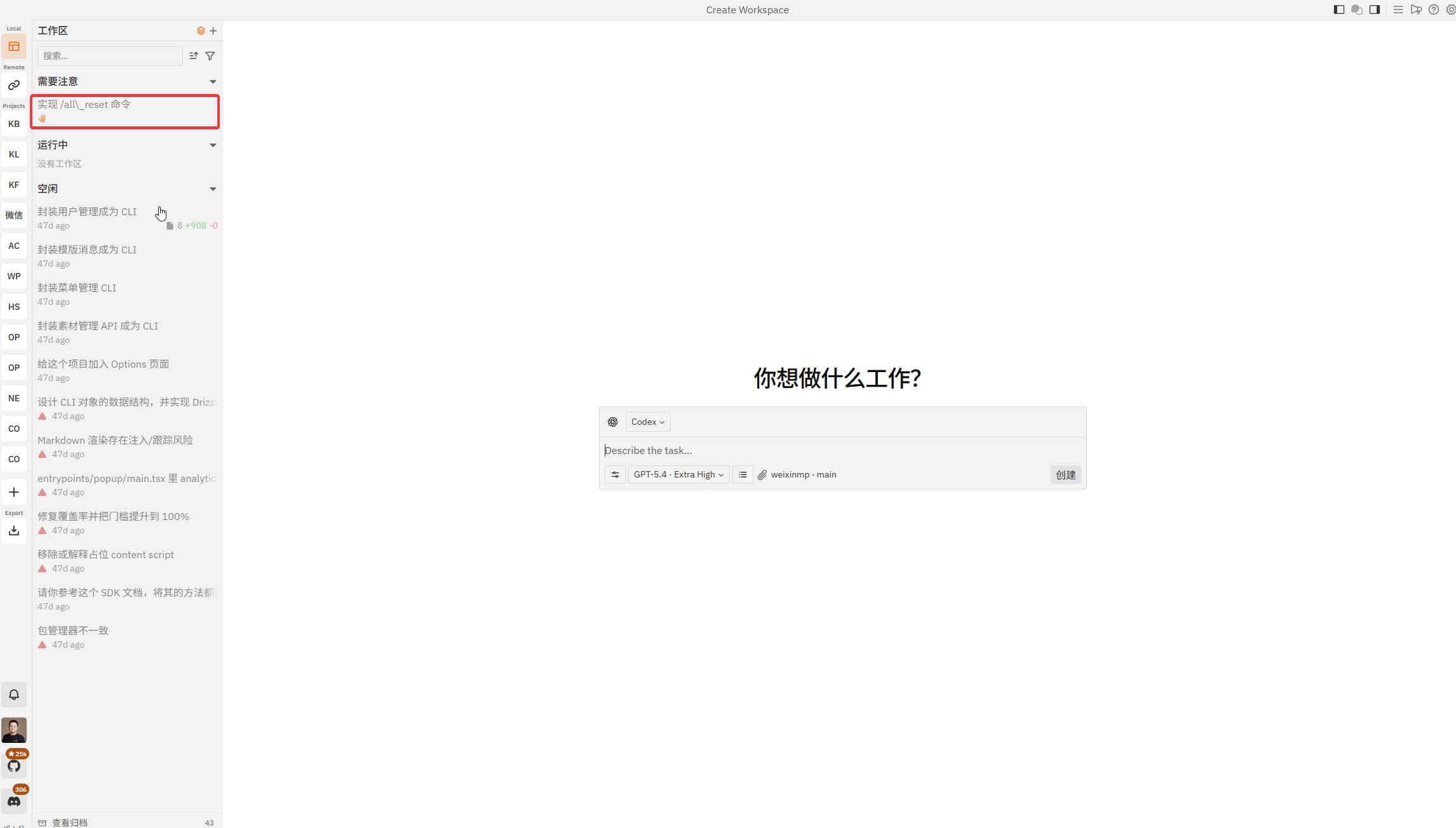

目前我是一个 VibeKanban 的重度依赖者;我会把我平时看到的一些任务直接添加到 Vibe Kanban 上。

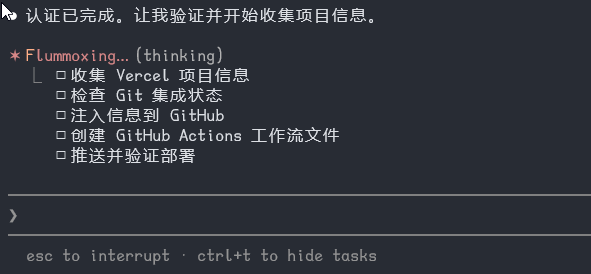

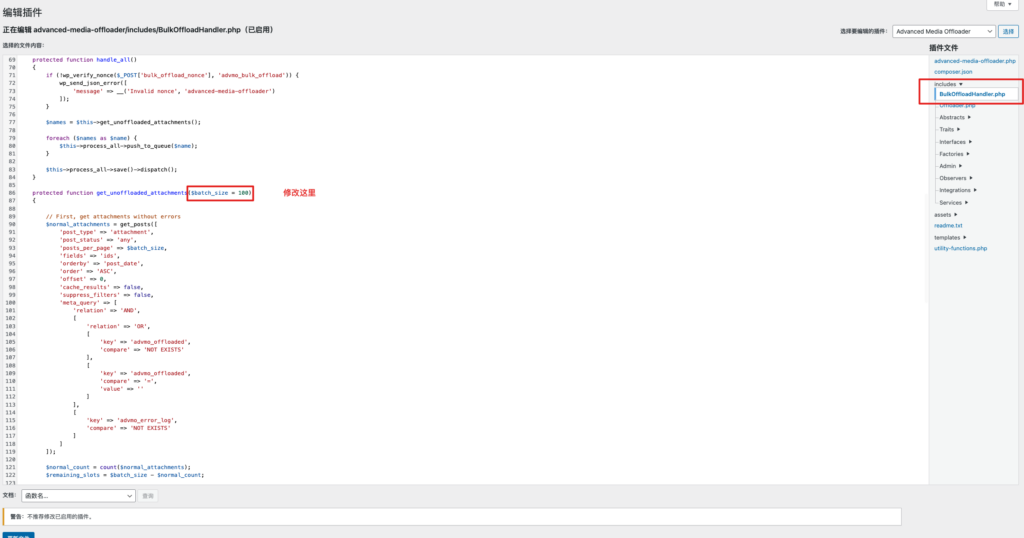

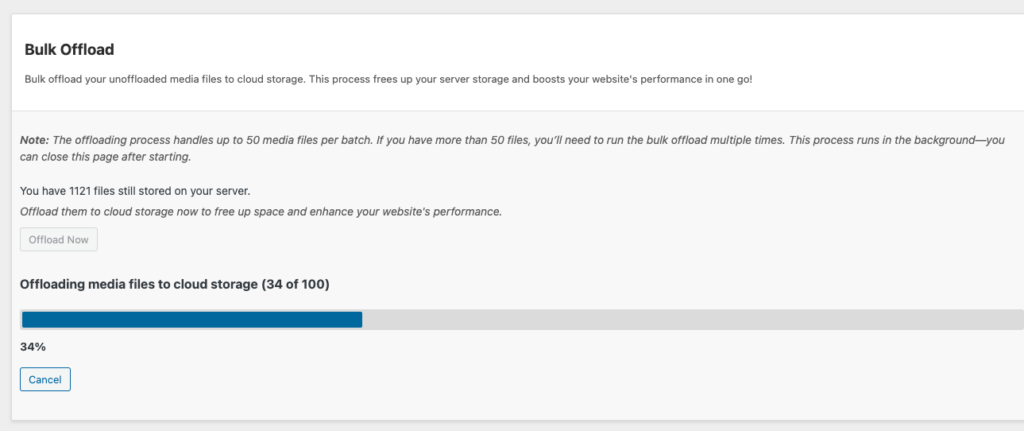

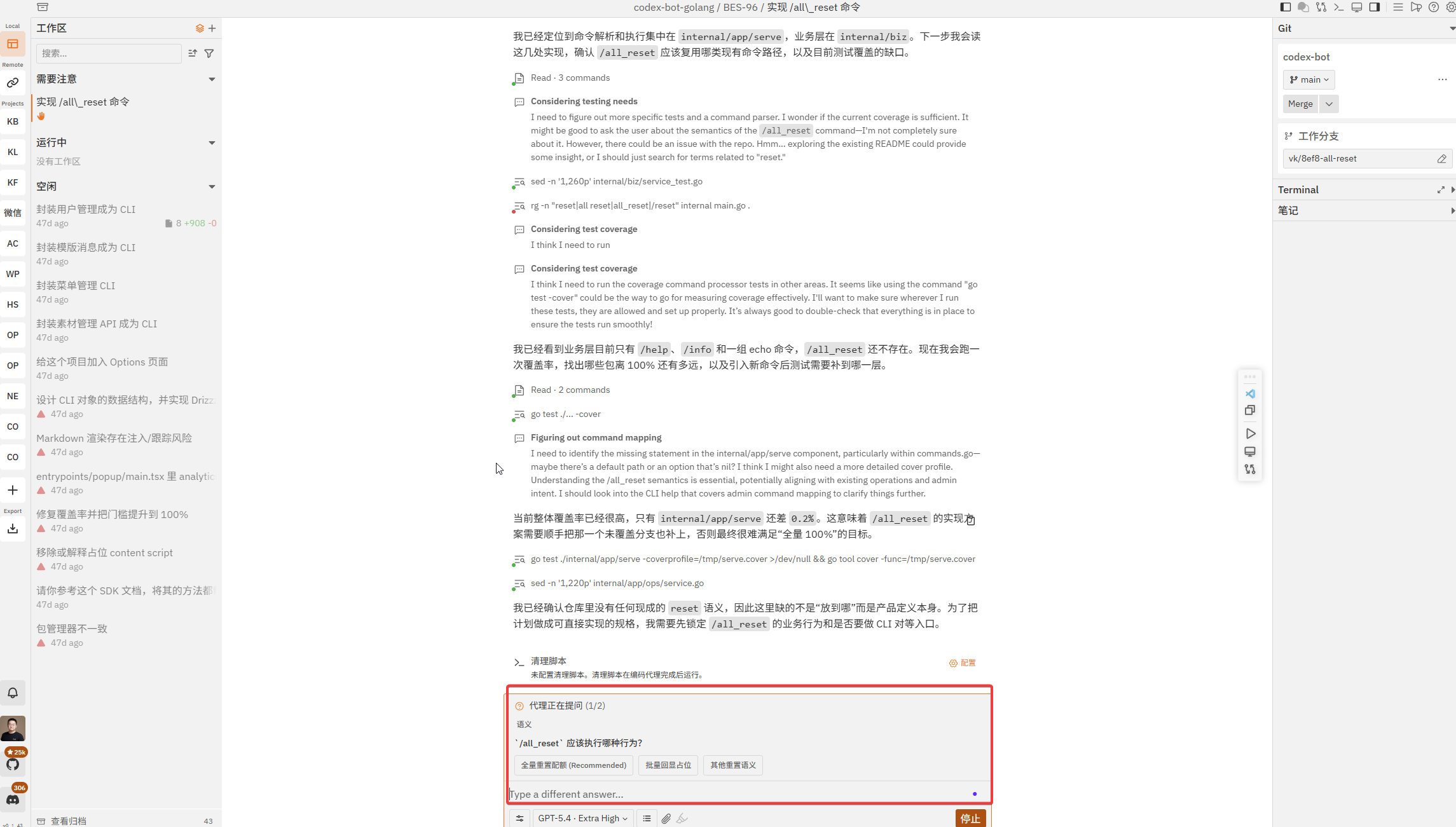

在完成任务细节的补充后,直接创建一个新的任务工作区,选择 Agent,并让 Agent 强制开启 Plan Mode,通过 Plan Mode 消除任务中的歧义。

最终汇总形成完整的设计方案后,批量让其执行起来;

因为 Agent 执行是需要周期的,所以我可以同步开启 N 个 Issue ,让 Agent 并行处理,并在 Agent 需要我介入的时候,参与到任务当中。

通过这样的方式,我快速且稳定的交付了大量的高质量的需求。

我所看中的 Vibe Kanban 的几个设计细节

1. Kanban 机制

当你 Scale 的 Agent 足够多的时候,你会发现,真正限制你的不是 Agent 的数量(这个很好突破,是钱的问题),真正限制的是你的认知带宽、你的管幅。一个你更熟悉的方式,会帮助你减少 Landing 和理解的成本。

Kanban 简单的 TODO、Doing、DONE 机制,让任务本身一目了然,我们可以轻松的把任务的当前状态、Next Action讲清楚、想清楚,也可以收敛每个任务的上下文。

2. 强制开启 Plan Mode

大部分人类在给 AI / Peer 安排任务的时候,其实是很差的,我们并没有说清楚需要做什么。这是因为我们脑海中有远超我们所表达的上下文。但如果我们没有安排出清楚的上下文时,不管是 AI 还是我们的 Peer ,其实都很难做好这些事。如果想要更好的让 AI / Peer 把事情做好,就需要把上下文交代的清楚。

既然人类不习惯,那不妨让 AI 来主动追问,通过 Plan Mode 来强制让 AI 主动发现任务细节中的歧义,并主动对话来消除歧义。

3. Agent 并发接入 & 自动的 Workspace 接入;

想要最大化你的时间和精力,一个比较好的办法是让你的下属 AI 能够并发进行处理任务,并充分的利用你的精力去做重要的决策。那么就需要同时启动多个 Agent,他们并行做计划、并行推进,从而打满你,让你可以始终处在决策、确认、检查、休息的环节,而不是无所事事。

Vibe Kanban 和 Git Worktree 做了非常好的集成,当你开始一个工作区的时候,他会自动为你创建一个新的 Worktree,并可以在你的任务完成后, Merge 进入你的 Main 分支当中,非常的方便。不仅如此,当你的变更和上游发生了冲突的时候,它还提供了 AI 解决冲突的能力,从而将复杂的分支管理给简化了。

4. 一丝丝幽默感

Vibe Kanban 是支持完成任务通知你的,而通知的方式也颇为幽默。他们提供了很多种音频来提醒你,比如 —— 牛的哞哞叫。是的,我的提醒音频就是牛叫,提醒我,我的 AI 牛马把活干完了,需要我去看了。

很好玩。

Vibe Kanban 适合谁?

从我自己的时候来看, Vibe Kanban 非常适合所有的「软件工程师」,他们的问题是虽然知道每一个任务应该怎么做,但没有足够的上下文带宽来并行,Vibe Kanban 提供了串行转并行的能力,帮助你更加快速的将自己 Scale 起来。

Vibe Kanban 真的像 —— 你将自己复制了 100 份,去分别执行不同的任务。你觉得自己分身乏术?这个就是那个分身之术。

但同样的,Vibe Kanban 也不是银弹,它不适合:

- 不适合还不会拆任务的人

- 不适合把 AI 当自动许愿机的人

- 不适合只想偶尔用一下 agent 的轻量用户

- 不适合还没有 review 能力的人

遗憾的是, Vibe Kanban 终将 Sunset

虽然 Vibe Kanban 我说的很好,但不得不说,就如标题一般 —— Vibe Kanban 终将 Sunset。这也是促使我来写这篇文章的重要原因,即将转向的 Vibe Kanban 值得你尽早体验。

VibeKanban 的方向是明确的,它代表了一种易于理解、易于拆解方案的 Agent Scale 实现。作为一种工作方式和实现,他无疑是成功的,但作为一个商业化产品来说,他可能又是失败的。 Vibe Kanban 的母公司 Bloop AI 已经宣布 Shutdown ,Vibe Kanban 项目也将专项 Open Source & community maintained。

在今天,如果你还困惑于如何 Scale Up 自己,最大化发挥出 Agent 的潜力,我觉得 Vibe Kanban 是一个你的必经之路。未来或许会有更好的解决方案,但 Vibe Kanban 的 Sunset 也浇灌出了新的可能性。

写在最后

Vibe Kanban 不仅仅是一个工具,他更代表着 —— 让软件工程师更加「软件工程」,我们更关心软件工程架构,而不是写代码。每一个软件工程师都可以依靠自己的经验管理一组 Coding Agent ,去做计划、去做执行。

Vibe Kanban 未必适合所有人,但如果你已经不满足于每次只用一个 Agent Chat 窗口,那么 Vibe Kanban 非常适合你试一试。